MySQL实现万亿级数据存储与处理服务 架构设计与关键技术解析

随着大数据时代的到来,处理万亿级数据已成为许多互联网公司和大型企业的常态需求。MySQL作为一款成熟稳定的关系型数据库,通过合理的架构设计与优化,同样能够支撑起海量数据的存储与处理。本文将从存储架构、分库分表策略、数据处理优化以及运维监控等方面,深入探讨MySQL如何实现万亿级数据存储服务。

一、万亿级数据存储架构设计

实现万亿级数据存储,单机MySQL显然无法满足需求,必须采用分布式架构。核心思路是将数据分散到多个数据库实例中,通过水平扩展来提升整体存储与处理能力。

1. 分库分表策略

分库分表是处理海量数据的经典方案。根据业务特点,可以选择以下策略:

- 垂直分库:按业务模块将不同表分布到不同数据库,如用户库、订单库、商品库等,减少单库压力。

- 水平分表:将单表数据按特定规则拆分到多个表中,如按用户ID哈希、按时间范围分区等。

对于万亿级数据,通常需要同时采用分库和分表,形成“分库+分表”的多级拆分架构。例如,先按业务分库,再在库内按用户ID哈希分表,最终将数据分布到数百甚至数千个物理表中。

2. 分布式中间件

分库分表后,应用程序不能直接访问底层数据库,需要通过分布式中间件来统一管理。常见的MySQL中间件包括:

- ShardingSphere:Apache开源项目,提供数据分片、读写分离、分布式事务等功能。

- MyCat:基于阿里Cobar开发的分布式数据库中间件。

- Vitess:YouTube开源的MySQL集群管理方案,适合超大规模场景。

中间件负责SQL解析、路由、结果合并等操作,对应用层透明,简化开发复杂度。

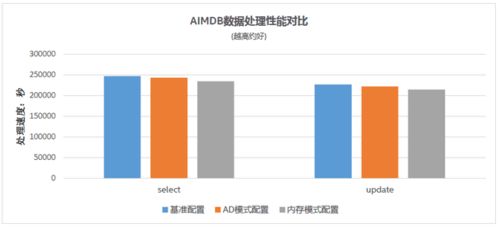

二、数据处理优化策略

存储海量数据只是基础,高效处理这些数据才是关键。

1. 读写分离与负载均衡

将读操作和写操作分离到不同实例:

- 主库负责写入和强一致性读操作

- 多个从库通过主从复制同步数据,承担读请求

通过负载均衡器(如HAProxy、LVS)分发读请求,提升整体吞吐量。

2. 数据分区与归档

- 时间分区:对按时间增长的数据(如日志、交易记录)按时间分区,便于历史数据归档和快速查询近期数据。

- 冷热数据分离:将访问频率低的历史数据迁移到廉价存储(如S3、OSS),MySQL只保留热数据,大幅降低存储成本。

3. 索引优化

万亿级数据下,索引设计尤为关键:

- 避免全表扫描,确保查询都能利用索引

- 使用覆盖索引减少回表操作

- 定期分析并删除冗余或低效索引

- 考虑使用复合索引和前缀索引

4. 批量操作与异步处理

- 将大量小操作合并为批量操作,减少网络往返和事务开销

- 非实时性任务采用异步处理,通过消息队列解耦

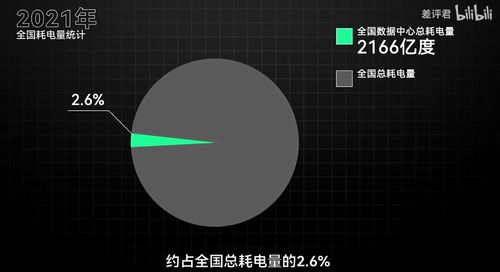

三、存储引擎与硬件优化

1. 存储引擎选择

- InnoDB:默认选择,支持事务、行级锁,适合大多数OLTP场景

- TokuDB:支持高压缩比和数据快速插入,适合日志类数据

- MyRocks:Facebook开发的存储引擎,压缩比高,写入性能优秀

2. 硬件配置

- SSD存储:使用NVMe SSD提升IO性能

- 大内存配置:增加内存容量,提高缓存命中率

- 高速网络:万兆网络减少节点间数据传输延迟

- CPU多核优化:MySQL 8.0对多核CPU支持更好,可配置更多并发线程

四、数据一致性与高可用

1. 分布式事务

跨库事务是分布式系统的难点,可采用的方案:

- XA事务:MySQL支持XA协议,但性能较差

- 最终一致性:通过消息队列、补偿事务等方式保证最终一致性

- TCC模式:Try-Confirm-Cancel模式,需要业务层配合实现

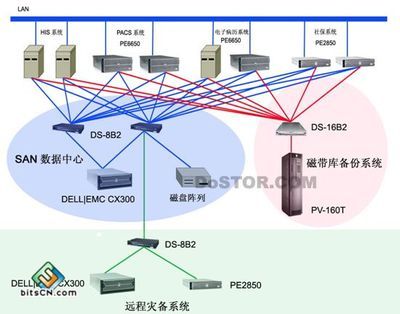

2. 高可用架构

- 主从复制:传统方案,简单可靠

- MHA/MMM:自动故障转移方案

- Group Replication:MySQL 5.7+原生集群方案,基于Paxos协议

- Orchestrator:可视化复制拓扑管理工具

3. 数据备份与恢复

- 物理备份:使用Percona XtraBackup进行全量和增量备份

- 逻辑备份:mysqldump导出数据,适合小规模数据

- 多地域备份:将备份存储在不同地域,防止地域性灾难

五、监控与运维体系

1. 全方位监控

- 数据库指标:QPS、TPS、连接数、慢查询、锁等待

- 系统指标:CPU、内存、磁盘IO、网络流量

- 业务指标:关键业务成功率、响应时间

2. 自动化运维

- 自动化部署:使用Ansible、Terraform等工具自动化部署数据库集群

- 弹性伸缩:根据负载自动扩缩容节点

- 智能调优:基于机器学习的参数自动调优

3. 容量规划与成本控制

- 定期分析数据增长趋势,提前规划扩容

- 使用云数据库服务时,合理选择实例类型和存储类型

- 实施数据生命周期管理,及时清理无用数据

六、实际案例参考

案例:电商平台订单系统

- 按用户ID哈希分库,共1024个分库

- 每个分库内按订单创建时间按月分表

- 使用ShardingSphere作为中间件

- 当前数据量:8000亿条记录,存储容量1.2PB

- 平均QPS:12万,峰值QPS:35万

###

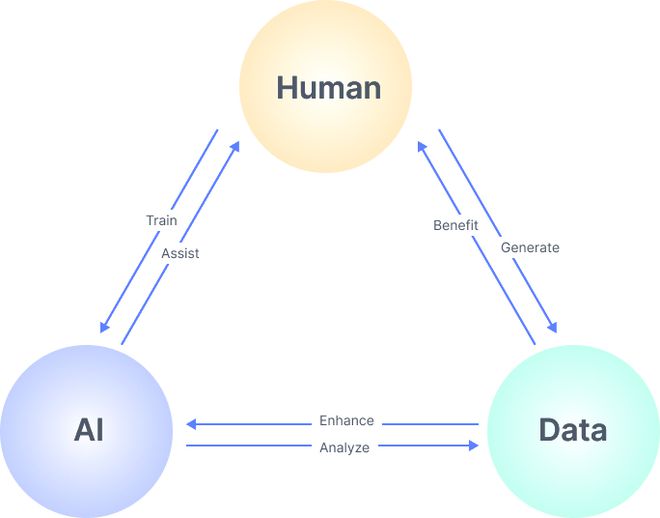

MySQL实现万亿级数据存储并非易事,需要综合考虑架构设计、数据分布、性能优化、高可用和运维管理等多个方面。随着MySQL 8.0的发布和云数据库服务的发展,处理海量数据的能力不断增强。但无论如何优化,业务层面的设计同样重要——合理的数据模型、适当的查询模式、有效的缓存策略,都是构建高效大数据系统的关键要素。

对于真正超大规模的场景,也可以考虑将MySQL与NoSQL数据库(如HBase、Cassandra)、大数据平台(如Hadoop、Spark)相结合,形成混合存储架构,充分发挥各类数据库的优势,构建更加健壮的数据存储与处理服务体系。

如若转载,请注明出处:http://www.somaodata.com/product/67.html

更新时间:2026-04-18 14:52:03